BitNet de Microsoft : Comment Faire Tourner un LLM de 100 Milliards de Paramètres sur un Simple CPU

Publié le 18 mars 2026Mis à jour le 18 mars 2026

Un modèle de 100 milliards de paramètres sur un processeur grand public : la promesse de BitNet

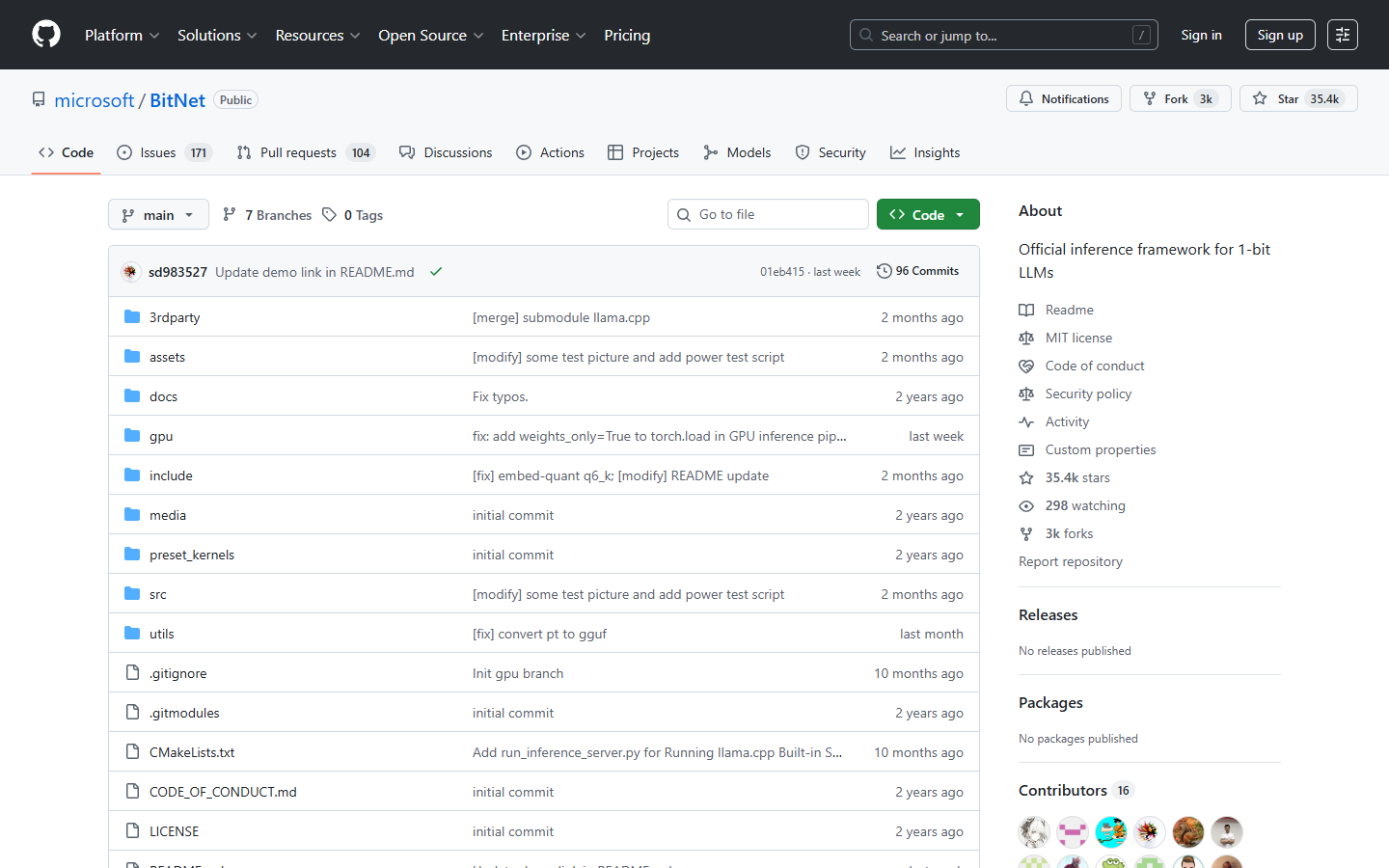

Faire tourner un LLM de 100 milliards de paramètres sans carte graphique. C'est la promesse de BitNet, le framework d'inférence open source développé par Microsoft Research. Publié sur GitHub où il cumule plus de 35 000 étoiles, BitNet repose sur une idée aussi simple que radicale : réduire les poids d'un réseau de neurones à trois valeurs seulement, soit -1, 0 et +1. Cette approche, appelée quantification ternaire à 1,58 bit, permet d'éliminer les opérations en virgule flottante au profit de simples additions d'entiers. Le résultat : un modèle de 100 milliards de paramètres capable de générer du texte à la vitesse de lecture humaine (5 à 7 tokens par seconde) sur un seul CPU.

En avril 2025, Microsoft a franchi une étape décisive en publiant BitNet b1.58 2B4T, le premier LLM 1-bit nativement entraîné à l'échelle de 2 milliards de paramètres, entraîné sur 4 000 milliards de tokens et distribué sous licence MIT. En janvier 2026, une mise à jour d'optimisation CPU a ajouté un gain de performance supplémentaire de 1,15x à 2,1x. Avec un écosystème qui ne cesse de s'étoffer, BitNet ne se présente plus comme une curiosité de laboratoire, mais comme une alternative crédible pour l'inférence locale et embarquée.

Qu'est-ce qu'un LLM 1-bit et comment fonctionne BitNet ?

Le principe de la quantification ternaire

Les LLM traditionnels stockent leurs poids sous forme de nombres à virgule flottante en 16 ou 32 bits. Chaque poids est un nombre décimal précis, ce qui exige beaucoup de mémoire et des opérations de multiplication coûteuses en énergie. BitNet adopte une approche radicalement différente : chaque poids du réseau est contraint à l'une des trois valeurs -1, 0 ou +1. C'est ce qu'on appelle la quantification ternaire.

Mathématiquement, il faut log2(3) = 1,58 bit pour encoder trois valeurs distinctes, d'où l'appellation « 1,58-bit ». Ce n'est pas une approximation grossière appliquée après coup (post-training quantization) : le modèle est entraîné nativement avec ces contraintes, ce qui lui permet d'apprendre à compenser la réduction de précision dès le départ.

Des multiplications aux additions

Le gain computationnel est immédiat. Lorsqu'un poids vaut +1, on additionne l'activation correspondante. Lorsqu'il vaut -1, on la soustrait. Lorsqu'il vaut 0, on ne fait rien. Les multiplications en virgule flottante, qui constituent l'essentiel du coût de calcul dans un LLM classique, disparaissent entièrement au profit d'opérations entières. Sur une puce 7 nm, cette transformation réduit l'énergie par opération arithmétique d'un facteur supérieur à 70x selon les estimations de Microsoft Research.

L'architecture BitLinear

Concrètement, BitNet remplace les couches linéaires standard (torch.nn.Linear) par des couches BitLinear personnalisées. Ces couches utilisent une quantification absmean pour les poids (qui les projette vers les valeurs ternaires) et une quantification absmax pour les activations (en entiers 8 bits, par token). Le modèle intègre également la normalisation SubLN, la fonction d'activation Squared ReLU (ReLU au carré), les embeddings positionnels rotatifs (RoPE) et le tokenizer de LLaMA 3 avec un vocabulaire de 128 256 tokens. Aucun biais n'est utilisé dans les couches linéaires ou de normalisation.

Les performances de BitNet : des chiffres qui parlent d'eux-mêmes

BitNet b1.58 2B4T face aux LLM full-precision

Le modèle phare de l'écosystème, BitNet b1.58 2B4T, a été rigoureusement évalué sur un large éventail de benchmarks. Ses performances rivalisent avec celles des meilleurs LLM open-weight de taille comparable, tout en offrant des gains d'efficacité considérables.

Métrique | LLaMA 3.2 (1B) | Qwen2.5 (1,5B) | BitNet b1.58 (2B) |

|---|---|---|---|

Mémoire (hors embeddings) | 2 Go | 2,6 Go | 0,4 Go |

Latence CPU (TPOT) | 48 ms | 65 ms | 29 ms |

Énergie estimée par inférence | 0,258 J | 0,347 J | 0,028 J |

ARC-Challenge (0-shot) | 37,80 | 46,67 | 49,91 |

PIQA (0-shot) | 74,21 | 76,12 | 77,09 |

WinoGrande (0-shot) | 59,51 | 62,83 | 71,90 |

GSM8K (4-shot, math) | 38,21 | 56,79 | 58,38 |

MMLU (5-shot) | 45,58 | 60,25 | 53,17 |

Moyenne générale | 44,90 | 55,23 | 54,19 |

Plusieurs résultats méritent votre attention. Sur le benchmark GSM8K, qui mesure le raisonnement mathématique, BitNet b1.58 surpasse Qwen2.5 (58,38 contre 56,79) malgré une empreinte mémoire 6,5 fois inférieure. Sur WinoGrande, qui évalue le raisonnement de bon sens, l'écart est encore plus net : 71,90 pour BitNet contre 62,83 pour Qwen2.5. En moyenne générale, BitNet atteint 54,19 contre 55,23 pour Qwen2.5, un écart minime compte tenu de la différence radicale d'efficacité.

L'efficacité énergétique : 12 fois mieux que Qwen2.5

Le chiffre le plus frappant est sans doute celui de la consommation énergétique : 0,028 joule par inférence pour BitNet, contre 0,347 joule pour Qwen2.5. BitNet est donc environ 12 fois plus économe en énergie. Pour LLaMA 3.2, le ratio est de 9x. Cette efficacité ne se limite pas au modèle 2B : sur les modèles de plus grande taille, les gains s'accentuent davantage.

Comparaison ARM vs x86 : les gains selon l'architecture CPU

Les performances de bitnet.cpp varient selon l'architecture du processeur. Sur les deux grandes familles de CPU, les résultats sont significatifs :

Architecture CPU | Gain de vitesse | Réduction d'énergie |

|---|---|---|

ARM (Apple M1/M2, Raspberry Pi) | 1,37x à 5,07x | 55,4 % à 70,0 % |

x86 (Intel, AMD) | 2,37x à 6,17x | 71,9 % à 82,2 % |

Sur les processeurs x86, les gains sont particulièrement impressionnants, avec un facteur d'accélération pouvant atteindre 6,17x et une réduction de la consommation énergétique de plus de 82 %. La mise à jour de janvier 2026 a ajouté des implémentations parallèles de noyaux avec un tuilage configurable et une quantification des embeddings, ce qui ajoute un gain supplémentaire de 1,15x à 2,1x par-dessus les optimisations existantes.

BitNet face à la quantification post-entraînement

Un point souvent soulevé : pourquoi ne pas simplement quantifier un modèle classique en 4 bits après l'entraînement ? Microsoft a justement comparé BitNet b1.58 aux versions INT4 (GPTQ et AWQ) de Qwen2.5 1,5B. Résultat : BitNet offre une empreinte mémoire encore inférieure (0,4 Go contre 0,7 Go) et de meilleures performances moyennes (55,01 contre 52,15 pour GPTQ-int4 et 51,17 pour AWQ-int4). La quantification native à l'entraînement s'avère donc supérieure à la quantification appliquée après coup.

Comment installer et utiliser BitNet

Prérequis système

Pour utiliser bitnet.cpp, vous aurez besoin de :

Python 3.9 ou supérieur

CMake 3.22 ou supérieur

Clang 18 ou supérieur (ou Visual Studio 2022 sous Windows)

Conda (recommandé pour la gestion de l'environnement)

Notez que le framework fonctionne aussi bien sous Linux, macOS que Windows. Sur Mac avec puce Apple Silicon (M1, M2, M3, M4), les performances sont particulièrement intéressantes grâce aux optimisations ARM.

Installation pas à pas

L'installation se fait en quelques commandes :

git clone --recursive https://github.com/microsoft/BitNet.git

cd BitNet

conda create -n bitnet-cpp python=3.9

conda activate bitnet-cpp

pip install -r requirements.txtEnsuite, téléchargez le modèle officiel depuis Hugging Face et configurez l'environnement :

huggingface-cli download microsoft/BitNet-b1.58-2B-4T-gguf --local-dir models/BitNet-b1.58-2B-4T

python setup_env.py -md models/BitNet-b1.58-2B-4T -q i2_sLancer une inférence

Une fois installé, vous pouvez lancer le modèle en mode conversationnel :

python run_inference.py -m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf -p "You are a helpful assistant" -cnvLe flag -cnv active le mode chat. Vous pouvez ajuster le nombre de threads (-t), la longueur du contexte (-c, jusqu'à 4 096 tokens) et la température (-temp). Pour évaluer les performances sur votre machine, un script de benchmark est fourni :

python utils/e2e_benchmark.py -m models/BitNet-b1.58-2B-4T/ggml-model-i2_s.gguf -n 200 -p 256 -t 4Un point important à retenir

Les gains de performance de BitNet ne sont obtenus qu'avec bitnet.cpp. Si vous chargez le modèle via Hugging Face Transformers de manière classique, vous ne bénéficierez pas des noyaux optimisés et les performances seront celles d'un modèle standard. Le framework spécialisé est indispensable.

L'écosystème BitNet : au-delà du modèle 2B

Les modèles compatibles

BitNet ne se limite pas au modèle officiel de Microsoft. L'écosystème inclut plusieurs modèles compatibles disponibles sur Hugging Face :

bitnet_b1_58-large (0,7B paramètres)

bitnet_b1_58-3B (3,3B paramètres)

Llama3-8B-1.58-100B-tokens (8B paramètres, version 1-bit de LLaMA 3)

Falcon3 Family (1B à 10B paramètres, de TII)

Falcon-E Family (1B à 3B paramètres)

L'adoption par l'équipe Falcon du Technology Innovation Institute est un signal fort : la quantification ternaire n'est plus une curiosité de Microsoft seul, mais un paradigme que d'autres acteurs commencent à adopter.

La feuille de route technique

Microsoft a posé des jalons clairs pour l'évolution de BitNet :

Octobre 2024 : sortie de bitnet.cpp 1.0 (inférence CPU)

Novembre 2024 : publication de BitNet a4.8 (activations 4 bits pour réduire davantage le coût)

Avril 2025 : modèle officiel 2B sur Hugging Face

Mai 2025 : noyaux d'inférence GPU

Janvier 2026 : optimisation CPU supplémentaire (1,15x à 2,1x)

À venir : support NPU (Neural Processing Unit)

BitNet a4.8, présenté en novembre 2024, pousse l'optimisation plus loin en utilisant des activations 4 bits et en ne mobilisant que 55 % des paramètres, ce qui réduit encore la latence. Cette variante supporte également un cache KV en 3 bits.

Comparaison avec les LLM traditionnels : que change vraiment BitNet ?

Le coût de l'inférence

Pour mettre les choses en perspective : un LLM traditionnel de 70 milliards de paramètres en précision complète nécessite environ 140 Go de mémoire et un cluster de GPU dont le coût avoisine les 40 000 dollars. L'inférence coûte entre 2 et 4 dollars par million de tokens via les API cloud. Un modèle BitNet de taille équivalente en 1,58 bit ne nécessite qu'environ 20 Go de mémoire, soit une réduction de 7x, et peut fonctionner sur un seul CPU. Le coût d'inférence tombe à 0,20 à 0,40 dollar par million de tokens, soit une réduction de 90 %.

Les limites actuelles

Il convient de rester lucide sur certaines limites. Premièrement, le modèle public le plus grand nativement entraîné en 1 bit reste le 2B4T à 2,4 milliards de paramètres. La possibilité de faire tourner 100 milliards de paramètres sur CPU a été démontrée par Microsoft avec des modèles de test, mais aucun modèle 100B nativement entraîné n'a encore été publié. Deuxièmement, Microsoft indique ne pas recommander l'utilisation de BitNet b1.58 en production commerciale sans tests complémentaires. Troisièmement, sur des benchmarks comme MMLU (connaissances générales), BitNet reste en retrait par rapport à Qwen2.5 (53,17 contre 60,25), ce qui suggère que la quantification ternaire a un coût sur certaines capacités qui nécessitent une précision fine.

Enfin, le GPU n'est pas encore pleinement optimisé pour les modèles 1-bit. Les architectures GPU actuelles sont conçues pour des opérations en virgule flottante, et les gains sur GPU sont moins spectaculaires que sur CPU. C'est un domaine où le matériel devra évoluer pour tirer pleinement parti de cette approche.

L'impact pour l'IA locale et embarquée

L'IA sans cloud, sans GPU, sans facture

BitNet s'inscrit dans une tendance de fond : la décentralisation de l'IA. En rendant possible l'inférence de modèles massifs sur du matériel grand public, le framework ouvre des perspectives concrètes :

Confidentialité totale : les données ne quittent jamais l'appareil de l'utilisateur

Fonctionnement hors ligne : aucune connexion internet requise

Coût nul après l'achat du matériel : pas d'abonnement API, pas de facture cloud

Déploiement sur des appareils embarqués : téléphones, objets connectés, dispositifs industriels

Accessibilité pour les chercheurs et les développeurs indépendants

Le futur du matériel 1-bit

Microsoft évoque dans ses publications la possibilité de développer des accélérateurs matériels spécifiquement conçus pour les opérations 1-bit. Si de tels processeurs voyaient le jour, les gains en vitesse et en efficacité énergétique pourraient augmenter de plusieurs ordres de grandeur. C'est un signal adressé à l'ensemble de l'industrie des semi-conducteurs : l'avenir de l'IA n'est peut-être pas dans des GPU toujours plus puissants, mais dans des processeurs optimisés pour des opérations minimalistes.

Ce qu'il faut retenir

BitNet représente un changement de paradigme dans la manière dont nous envisageons le déploiement des LLM. En prouvant qu'un modèle de 100 milliards de paramètres peut tourner sur un CPU unique à la vitesse de lecture humaine, Microsoft Research repousse les frontières de ce qui est possible sans matériel spécialisé. Le modèle BitNet b1.58 2B4T, premier LLM 1-bit nativement entraîné et publié en open source, démontre que la performance n'est pas nécessairement synonyme de gaspillage computationnel.

Avec 35 000 étoiles sur GitHub, un écosystème de modèles qui s'élargit (Falcon, LLaMA 1-bit), des mises à jour régulières et une licence MIT, BitNet est aujourd'hui l'un des projets les plus prometteurs pour démocratiser l'accès à l'intelligence artificielle. La question n'est plus de savoir si l'IA locale deviendra la norme, mais à quelle vitesse des frameworks comme BitNet vont transformer notre manière de déployer et d'utiliser les LLM.

Des prix clairs, transparents et sans frais cachés.

Aucun engagement, des prix pour vous aider à augmenter votre prospection.

Crédits(optionnel)

Vous n'avez pas besoin de crédits si vous voulez simplement envoyer des emails ou faire des actions sur LinkedIn

Peuvent être utilisés pour :

Trouver Emails

Action IA

Trouver des Numéros

Vérifier des Emails

19€par mois

1 000

5 000

10 000

50 000

100 000

1 000 Emails trouvés

1 000 IA Actions

20 Numéros

4 000 Vérifications

19€par mois

Découvrez d'autres articles qui pourraient vous intéresser !

Voir tous les articlesBlog

Publié le 19 juin 2025

Les 8 meilleures applications d'enquête en 2026

Mathieu Co-founder

Mathieu Co-founderLire la suite

Logiciels

Publié le 9 juin 2025

Les 8 meilleurs logiciels de présentation en 2026

Niels Co-founder

Niels Co-founderLire la suite

IA

Publié le 15 mai 2025

Les 10 meilleurs chatbots IA en 2026 : transformez votre entreprise

Marie Head Of Sales

Marie Head Of SalesLire la suite

Conseils et formations

Publié le 8 juin 2025

Top 6 Plugins WordPress SEO 2026 : Boostez Votre Classement

Niels Co-founder

Niels Co-founderLire la suite

Blog

Publié le 13 juil. 2025

10 Idées pour faire connaitre son business gratuitement

Niels Co-founder

Niels Co-founderLire la suite

Logiciels

Publié le 15 mai 2025

6 Meilleurs logiciels montage vidéo gratuit : contenus pro gratuits

Mathieu Co-founder

Mathieu Co-founderLire la suite

Liens utiles

HubCold-email: Guide CompletDélivrabilité: Guide completAlternative à LemlistAPIDemander une démoProgramme d'affiliationFind emailConsultingA propos

Politique de confidentialitéCGVMentions légalesTestimonialsRoadmapAlternativesComparaisonsContactMade with ❤ for Growth Marketers by Growth Marketers

Copyright © 2026 Emelia All Rights Reserved