Retour au hub

Blog

IA

DeepSeek V4 : Guide Complet du Modele IA 1T

Publié le 10 mars 2026Mis à jour le 18 mars 2026

Chez Emelia, notre plateforme de prospection B2B, nous integrons des modeles d'intelligence artificielle au coeur de nos fonctionnalites, qu'il s'agisse de la redaction automatisee d'emails de prospection ou de l'enrichissement de donnees. Chez Bridgers, notre agence digitale et IA, nous accompagnons des entreprises dans l'integration de solutions d'IA sur mesure. Et avec Maylee, notre client email IA-natif, nous repoussons les limites de la productivite grace a l'intelligence artificielle. Quand un modele de la taille de DeepSeek V4 se profile a l'horizon, avec 1 000 milliards de parametres et des capacites multimodales natives, nous estimons essentiel de vous fournir une analyse complete de ce que cela change pour les professionnels et les entreprises.

Qu'est-ce que DeepSeek V4 ?

DeepSeek V4 est le prochain grand modele de langage developpe par DeepSeek, le laboratoire chinois d'intelligence artificielle qui a bouleverse l'industrie en 2026 avec son modele V3 et la serie DeepSeek-R1. Si les informations circulant dans la communaute se confirment, V4 represente un saut generationnel a plusieurs egards.

Le modele reposerait sur une architecture Mixture-of-Experts (MoE) totalisant environ 1 000 milliards de parametres, soit pres de 50 % de plus que les 671 milliards de V3. Mais l'une des innovations majeures reside dans l'efficacite : seuls 32 milliards de parametres seraient actifs par token genere, contre 37 milliards pour V3. En d'autres termes, DeepSeek V4 serait a la fois plus puissant et plus leger en inference.

L'architecture combine plusieurs innovations cles :

MoE (Mixture-of-Experts) : permet d'activer uniquement une fraction des parametres a chaque requete, reduisant considerablement les couts de calcul.

MLA (Multi-head Latent Attention) : une version optimisee de l'attention multi-tete, deja presente dans V3.

Engram Memory : un systeme de memoire conditionnelle, documente dans un article scientifique publie le 12 janvier 2026 (arXiv:2601.07372), qui permet au modele de stocker et de rappeler des informations de maniere plus efficace.

DSA (Dynamic Sparse Attention) : un mecanisme d'attention dynamique et parcimonieux qui contribue a la gestion de la fenetre contextuelle massive.

Car c'est peut-etre la le changement le plus spectaculaire pour les utilisateurs : la fenetre de contexte passe de 128 000 tokens (V3) a 1 million de tokens. Ce n'est pas une simple declaration marketing. Depuis le 11 fevrier 2026, DeepSeek a silencieusement elargi la fenetre contextuelle de son API a 1 million de tokens, ce qui laisse penser que la technologie fonctionne deja en production.

Quoi de neuf par rapport a DeepSeek V3 ?

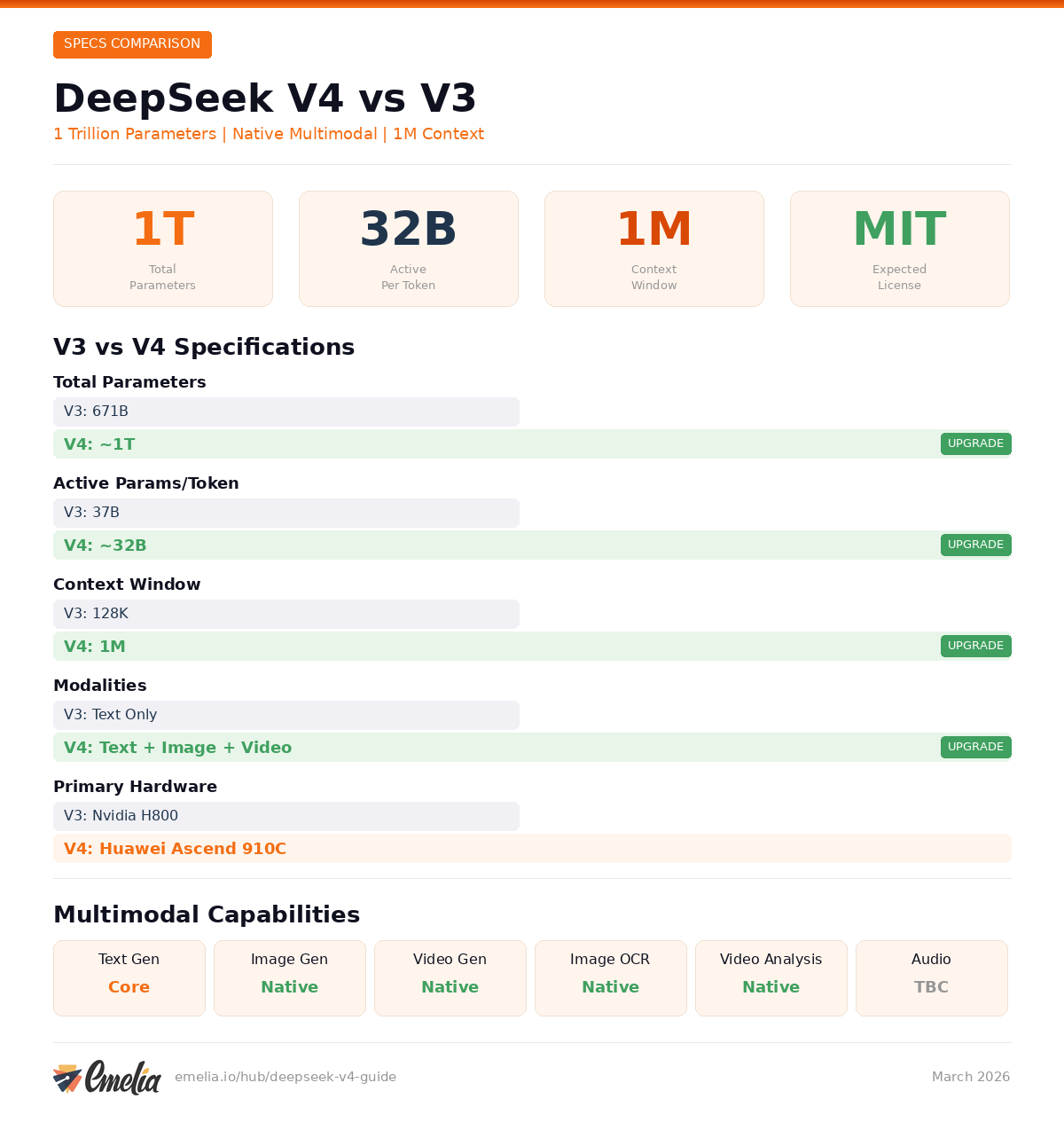

Pour mesurer l'ampleur du saut, voici un comparatif direct :

Specification | DeepSeek V3 | DeepSeek V4 (attendu) |

|---|---|---|

Parametres totaux | 671 milliards | ~1 000 milliards |

Parametres actifs par token | 37 milliards | ~32 milliards |

Fenetre de contexte | 128 000 tokens | 1 000 000 tokens |

Modalites | Texte uniquement | Texte + Image + Video |

Hardware principal | Nvidia H800 | Huawei Ascend 910C |

Licence | MIT | MIT (attendue) |

Trois elements se demarquent. Premierement, la reduction des parametres actifs malgre l'augmentation massive des parametres totaux traduit un travail d'optimisation remarquable. Deuxiemement, le passage a 1 million de tokens de contexte place V4 dans une categorie a part : il devient possible de traiter des documents entiers, des bases de code completes ou des corpus de recherche en une seule requete. Troisiemement, le passage au multimodal natif transforme fondamentalement la nature du modele.

Quelles sont les capacites multimodales de DeepSeek V4 ?

Contrairement a V3 qui se limitait au texte, DeepSeek V4 est concu des le depart comme un modele multimodal. Voici le detail des capacites attendues :

Capacite | Description | Statut |

|---|---|---|

Generation de texte | Redaction, code, analyse, traduction | Confirme |

Comprehension d'images | Analyse visuelle, OCR, Q&A visuel | Confirme |

Generation d'images | Text-to-image, assistance au design | Confirme |

Comprehension video | Resume, analyse de contenu video | Confirme |

Generation video | Courtes sequences animees | Confirme |

Traitement audio | Transcription, analyse vocale | Non confirme |

Le fait que ces capacites soient natives, et non greffees apres coup, est un point crucial. Les modeles multimodaux les plus performants sont generalement ceux ou les differentes modalites ont ete integrees des la phase d'entrainement, plutot qu'ajoutees via des modules supplementaires. Cela suggere une comprehension plus profonde des relations entre texte, image et video.

Benchmarks et performances : que disent les fuites ?

Aucun benchmark officiel n'a ete publie, mais des fuites internes ont circule dans la communaute :

HumanEval (evaluation du code) : 90 %, un score qui placerait V4 au-dessus de la plupart des modeles concurrents.

SWE-bench (resolution de bugs logiciels reels) : superieur a 80 %, suggerant des capacites pratiques en ingenierie logicielle.

Des scores sur MMLU-Pro et GPQA Diamond ont egalement fuite, mais n'ont pas ete confirmes.

Selon ces memes fuites, DeepSeek V4 surpasserait Claude et GPT sur les taches de programmation. Cela reste a verifier avec des benchmarks independants, mais la trajectoire de DeepSeek, dont V3 avait deja surpris l'industrie, rend ces chiffres plausibles.

L'angle Huawei : vers une IA independante de Nvidia

L'un des aspects les plus strategiques de DeepSeek V4 concerne le hardware. Si V3 avait ete entraine sur des GPU Nvidia H800, V4 marque un tournant : le modele serait optimise pour fonctionner sur les puces Huawei Ascend 910B et 910C.

DeepSeek aurait obtenu un acces anticipe aux puces Huawei, un privilege qui n'a ete accorde ni a Nvidia, ni a AMD. Si cela se confirme, DeepSeek V4 deviendrait le premier modele a 1 000 milliards de parametres optimise entierement en dehors de l'ecosysteme Nvidia.

Les implications sont considerables. Pour l'ecosysteme IA chinois, c'est la demonstration qu'il est possible de former et de deployer des modeles de pointe sans dependre des exportations americaines de semiconducteurs. Pour les entreprises internationales, cela signifie qu'une alternative credible a l'infrastructure Nvidia commence a emerger, meme si les performances chip-par-chip restent en faveur de Nvidia pour le moment.

En pratique, DeepSeek aurait utilise les puces Nvidia pour l'entrainement et relegue les puces Huawei a l'inference. Une approche pragmatique qui pourrait evoluer avec les prochaines generations de puces Ascend.

Cas d'usage et applications business de DeepSeek V4

C'est ici que DeepSeek V4 devient concretement interessant pour les professionnels. Voici les scenarios d'utilisation les plus prometteurs.

Assistant de developpement et de code

Avec un score de 90 % sur HumanEval et une fenetre contextuelle de 1 million de tokens, V4 pourrait analyser des bases de code entieres en une seule requete. Pour une equipe de developpeurs, cela signifie la possibilite de soumettre un depot GitHub complet et de demander une revue de code, une refactorisation ou une detection de vulnerabilites sur l'ensemble du projet. Pas fichier par fichier, mais le projet dans sa globalite.

Analyse documentaire a grande echelle

La fenetre de 1 million de tokens permet de charger des documents volumineux : rapports annuels complets, contrats de plusieurs centaines de pages, dossiers reglementaires. Un cabinet d'avocats pourrait soumettre l'integralite d'un dossier contentieux. Un analyste financier pourrait charger plusieurs rapports trimestriels simultanement pour une analyse comparative.

Creation de contenu multimodal

Pour les equipes marketing et les createurs de contenu, les capacites multimodales natives ouvrent des perspectives inedites. Imaginez un outil capable de generer simultanement le texte d'un article, les illustrations qui l'accompagnent et une courte video promotionnelle, le tout coherent et aligne sur un brief unique.

Alternative economique a GPT et Claude pour les API

DeepSeek s'est positionne comme une alternative nettement moins couteuse que les modeles d'OpenAI et d'Anthropic. Si V4 maintient cette politique tarifaire (V3 a ete entraine pour environ 5,6 millions de dollars), les entreprises qui consomment massivement des API d'IA pourraient realiser des economies significatives sans sacrifier la qualite.

Souverainete des donnees et auto-hebergement

Sous licence MIT, V4 serait entierement auto-hebergeable. Pour les entreprises soumises a des contraintes reglementaires strictes (sante, defense, finance), c'est un atout majeur : aucune donnee ne quitte vos serveurs. C'est aussi un avantage pour les entreprises europeennes qui souhaitent rester conformes au RGPD sans dependre de fournisseurs americains.

Optimisation du marche chinois

Avec des scores eleves sur les benchmarks C-Eval, V4 est un choix naturel pour les entreprises ciblant le marche chinois. La comprehension des nuances linguistiques et culturelles depasse ce que proposent les modeles occidentaux.

Combien coute l'auto-hebergement de DeepSeek V4 ?

L'auto-hebergement d'un modele a 1 000 milliards de parametres n'est pas une mince affaire. Voici les estimations :

En FP16 (precision complete) : environ 2 To de VRAM, necessitant plusieurs GPU A100 ou H100 en cluster.

En quantification Q4_K_M : environ 500 Go, ce qui reste consequent.

Configuration minimale : une approche multi-noeuds ou une quantification a 8 bits sur 4x RTX 4090 pourrait fonctionner, mais avec des compromis sur la vitesse d'inference.

Pour une entreprise, cela represente un investissement materiel de l'ordre de 50 000 a 200 000 euros selon la configuration, sans compter les couts d'electricite et de maintenance. L'alternative la plus accessible reste l'utilisation via l'API DeepSeek, dont les tarifs ont historiquement ete tres competitifs.

Quand sort DeepSeek V4 ?

C'est la question a un million de tokens. La chronologie des evenements est revelatrice :

12 janvier 2026 : publication de l'article sur la memoire Engram, consideree comme une brique fondamentale de V4.

Janvier 2026 : fuite de code reference sous le nom "MODEL1" sur GitHub.

11 fevrier 2026 : expansion silencieuse de la fenetre contextuelle a 1 million de tokens sur l'API existante.

17 fevrier 2026 : date d'annonce attendue par la communaute. Rien ne se passe.

3 mars 2026 : date de lancement rumoree, coincidant avec les Deux Sessions (evenement politique majeur en Chine). Toujours rien.

5 mars 2026 : OpenAI lance GPT-5.4.

10 mars 2026 : toujours aucune sortie officielle.

Plusieurs hypotheses circulent pour expliquer ce retard. La plus probable : le lancement de GPT-5.4 par OpenAI le 5 mars aurait pousse DeepSeek a recalibrer ses benchmarks pour s'assurer que V4 puisse etre presente comme un concurrent credible du nouveau modele d'OpenAI. D'autres evoquent des difficultes d'optimisation liees aux puces Huawei, ou simplement un calendrier interne qui n'a jamais ete celui que la communaute imaginait.

Limites et zones d'ombre de DeepSeek V4

Il serait irresponsable de presenter uniquement les aspects positifs. Voici ce que nous ne savons pas encore, ou ce qui pourrait poser probleme.

Aucun benchmark independant. Toutes les performances citees proviennent de fuites internes. Tant que des evaluations independantes n'auront pas ete realisees, ces chiffres restent a prendre avec precaution.

La censure intrinseque. Comme tous les modeles chinois, DeepSeek est soumis aux reglementations du gouvernement chinois. Les versions accessibles via l'API peuvent refuser de repondre a certaines questions considerees comme sensibles. L'auto-hebergement du modele open-source attenuerait ce probleme, mais ne l'elimine pas completement, car le biais peut etre ancre dans les donnees d'entrainement.

Le multimodal reste a prouver. Les capacites de generation d'images et de video annoncees n'ont pas ete demontrees publiquement. La qualite reelle pourrait etre en deca des attentes, surtout face a des modeles specialises comme DALL-E 3, Midjourney ou Sora.

Le cout d'inference a grande echelle. Meme si le cout d'entrainement est faible, le cout d'inference pour un modele a 1 000 milliards de parametres, meme avec un MoE efficace, reste une inconnue. Les tarifs API n'ont pas ete annonces.

La dependance aux puces Huawei. Si l'optimisation Huawei est un atout strategique, elle constitue aussi un risque. Les puces Ascend n'ont pas le meme ecosysteme logiciel que Nvidia (CUDA), ce qui pourrait compliquer les deployements pour les entreprises habituees a l'ecosysteme Nvidia.

A qui s'adresse DeepSeek V4 ?

Vous devriez vous y interesser si :

Vous etes developpeur ou equipe technique cherchant un modele de code performant et auto-hebergeable.

Vous gerez de gros volumes documentaires et avez besoin d'une fenetre de contexte massive.

Vous cherchez une alternative moins couteuse a GPT et Claude pour vos besoins en API.

Vous avez des exigences de souverainete des donnees et souhaitez un modele open-source hebergeable en interne.

Vous travaillez sur le marche chinois et avez besoin d'un modele qui comprend les nuances culturelles locales.

Vous etes un passione d'IA qui veut comprendre les derniers developpements du secteur.

Vous pouvez attendre si :

Vous utilisez deja GPT-5.4 ou Claude et en etes satisfait, tant que les benchmarks independants ne sont pas disponibles.

Vous n'avez pas l'infrastructure pour auto-heberger un modele de cette taille et preferez des solutions SaaS etablies.

Vous avez besoin de garanties de stabilite et de support enterprise que seuls OpenAI et Anthropic proposent aujourd'hui.

Vos cas d'usage ne necessitent ni une fenetre de contexte massive, ni des capacites multimodales.

Conclusion : DeepSeek V4, un modele a surveiller de pres

DeepSeek V4 s'annonce comme l'un des modeles d'IA les plus ambitieux de 2026. Avec 1 000 milliards de parametres, une fenetre de 1 million de tokens, des capacites multimodales natives et une licence open-source, il coche toutes les cases qui comptent pour les entreprises et les developpeurs.

Mais il n'est pas encore sorti. Et tant qu'il ne l'est pas, tout ce que nous avons, ce sont des fuites, des rumeurs et des signaux. La trajectoire de DeepSeek, qui a systematiquement surpris l'industrie avec V3 et R1, rend ces promesses credibles. Le contexte geopolitique et la competition avec GPT-5.4 ajoutent une couche de suspense supplementaire.

Ce qui est certain, c'est que le jour ou DeepSeek V4 sera effectivement disponible, il sera l'un des modeles les plus importants a evaluer pour quiconque utilise l'IA dans un contexte professionnel. Nous ne manquerons pas de le tester en profondeur des sa sortie.

Des prix clairs, transparents et sans frais cachés.

Aucun engagement, des prix pour vous aider à augmenter votre prospection.

Crédits(optionnel)

Vous n'avez pas besoin de crédits si vous voulez simplement envoyer des emails ou faire des actions sur LinkedIn

Peuvent être utilisés pour :

Trouver Emails

Action IA

Trouver des Numéros

Vérifier des Emails

19€par mois

1 000

5 000

10 000

50 000

100 000

1 000 Emails trouvés

1 000 IA Actions

20 Numéros

4 000 Vérifications

19€par mois

Découvrez d'autres articles qui pourraient vous intéresser !

Voir tous les articlesLogiciels

Publié le 14 mai 2024

7 alternatives à Folderly pour Doper votre Délivrabilité en 2026

Marie Head Of Sales

Marie Head Of SalesLire la suite

Ventes

Publié le 12 mai 2025

C'est quoi la demande génération? Explication, Tactiques et Avantages

Niels Co-founder

Niels Co-founderLire la suite

Logiciels

Publié le 25 mai 2025

Les 15 meilleurs logiciels gratuits pour remplacer Photoshop

Mathieu Co-founder

Mathieu Co-founderLire la suite

Marketing

Publié le 10 juil. 2025

ERP vs CRM 2026 : différences et impact sur la prospection

Niels Co-founder

Niels Co-founderLire la suite

Logiciels

Publié le 7 août 2024

Lemlist vs Waalaxy 2026 : quel outil LinkedIn choisir ?

Marie Head Of Sales

Marie Head Of SalesLire la suite

Logiciels

Publié le 2 mai 2024

7 Meilleures Alternatives à Lemlist : Le Guide Ultime 2026

Marie Head Of Sales

Marie Head Of SalesLire la suite

Liens utiles

HubCold-email: Guide CompletDélivrabilité: Guide completAlternative à LemlistAPIDemander une démoProgramme d'affiliationFind emailConsultingA propos

Politique de confidentialitéCGVMentions légalesTestimonialsRoadmapAlternativesComparaisonsContactMade with ❤ for Growth Marketers by Growth Marketers

Copyright © 2026 Emelia All Rights Reserved