Hindsight : le système de mémoire open source qui permet aux agents IA d'apprendre (91,4 % sur LongMemEval)

Publié le 18 mars 2026Mis à jour le 19 mars 2026

Pourquoi la mémoire est le maillon faible des agents IA

Les agents IA savent raisonner, appeler des outils et orchestrer des workflows complexes. Mais demandez-leur de se souvenir d'une conversation de la semaine dernière, et la plupart d'entre eux partent de zéro. Cette amnésie chronique est le talon d'Achille de l'IA agentique en 2026.

Le problème ne vient pas des modèles de langage eux-mêmes. Il vient de la manière dont la mémoire a été traitée jusqu'ici dans les architectures d'agents. La solution dominante, le RAG (Retrieval-Augmented Generation), a été conçue pour répondre à des questions ponctuelles sur des documents statiques. Le principe est simple : découper des documents en fragments, les transformer en vecteurs, stocker le tout dans une base vectorielle, puis retrouver les passages les plus proches sémantiquement lorsqu'une requête arrive.

Cette approche fonctionne pour des questions isolées. Elle s'effondre dès que l'on demande à un agent de travailler sur des sessions longues, de retenir du contexte dans la durée ou de distinguer ce qu'il a observé de ce qu'il croit. Le RAG traite toutes les informations récupérées de manière uniforme : un fait appris il y a six mois pèse autant qu'une opinion formée hier. Des informations contradictoires coexistent sans mécanisme de réconciliation. Le système ne sait ni représenter l'incertitude, ni suivre l'évolution des croyances, ni comprendre pourquoi une conclusion particulière a été tirée.

C'est dans ce contexte que Vectorize a lancé Hindsight en décembre 2025 : un système de mémoire open source conçu pour fonctionner comme la mémoire humaine. Les résultats sont sans ambiguïté : 91,4 % de précision sur le benchmark LongMemEval, le score le plus élevé jamais enregistré, tous systèmes confondus.

L'architecture biomimétique de Hindsight

La philosophie de Hindsight repose sur une idée simple mais puissante : la mémoire d'un agent IA devrait fonctionner comme la mémoire humaine, pas comme un moteur de recherche. Là où la plupart des systèmes de mémoire se contentent de stocker et retrouver des fragments de texte, Hindsight organise l'information en quatre types de mémoire distincts, chacun jouant un rôle différent dans le raisonnement de l'agent.

Les quatre types de mémoire

Type | Ce qu'il stocke | Exemple |

|---|---|---|

World (Faits) | Faits objectifs sur le monde | « Alice travaille chez Google en tant qu'ingénieure logicielle » |

Experiences | Actions et interactions propres de l'agent | « J'ai recommandé Python à Bob pour son projet » |

Opinions | Croyances avec score de confiance | « Il ne faut pas toucher le poêle » (confiance : 0,99) |

Observations | Modèles mentaux complexes issus de la réflexion | « Les fers à friser, les fours et le feu sont aussi chauds. Il ne faut pas les toucher non plus. » |

Cette séparation est fondamentale. Elle crée ce que les chercheurs appellent la « clarté épistémique » : la distinction nette entre ce que l'agent sait (faits), ce qu'il a vécu (expériences), ce qu'il croit (opinions) et ce qu'il a déduit (observations). Quand un agent formule une opinion, la croyance est stockée séparément des faits qui la soutiennent, accompagnée d'un score de confiance. Lorsque de nouvelles données arrivent, le système peut renforcer ou affaiblir les croyances existantes au lieu de traiter toutes les informations stockées avec le même degré de certitude.

Chaque fait stocké est assigné à exactement un réseau et attaché à un graphe de mémoire partagé. Ce graphe relie les unités de mémoire à travers quatre types de liens : entité (même entité canonique), temporel (proximité dans le temps avec décroissance exponentielle), sémantique (similarité d'embeddings élevée) et causal (relations de cause à effet).

Résolution d'entités et conscience temporelle

Hindsight ne se contente pas de stocker du texte brut. Le système extrait des faits structurés à partir des conversations, résout les entités (de sorte que « Alice », « Alice Chen » et « la nouvelle PM » correspondent toutes à la même personne) et construit un graphe de connaissances qui capture les relations entre entités, événements et concepts.

Chaque fait stocke deux horodatages distincts : le moment où l'événement s'est produit (occurrence) et le moment où l'agent en a pris connaissance (mention). Un fait retenu en janvier 2025 à propos du mariage d'Alice en juin 2024 peut ainsi répondre aussi bien à « Qu'a fait Alice en 2024 ? » qu'à « Qu'ai-je appris récemment ? ». Les requêtes comme « le printemps dernier » ou « avant la fusion » sont automatiquement converties en plages de dates.

Les trois opérations : Retain, Recall, Reflect

Hindsight s'articule autour de trois opérations fondamentales qui régissent le cycle de vie complet de la mémoire.

Retain : stocker l'information de manière structurée

L'opération retain transforme les interactions brutes en mémoire structurée et temporellement consciente. En coulisses, le système utilise un LLM pour extraire les faits clés, les données temporelles, les entités et les relations. Ces éléments passent par un processus de normalisation qui les transforme en entités canoniques, séries temporelles et index de recherche.

La pipeline de rétention traite les données d'entrée en extrayant des faits narratifs, en générant des embeddings, en résolvant les entités et en construisant quatre types de liens dans le graphe : temporels, sémantiques, d'entité et causaux.

Recall : retrouver avec précision grâce à TEMPR

L'opération recall est le cœur du système de récupération. Contrairement aux systèmes RAG classiques qui se limitent à la recherche vectorielle, Hindsight exécute quatre stratégies de recherche en parallèle via son système TEMPR (Temporal Entity Memory Priming Retrieval).

Stratégie | Usage optimal |

|---|---|

Sémantique (vecteur) | Similarité conceptuelle, paraphrase |

Mots-clés (BM25) | Noms propres, termes techniques, correspondances exactes |

Graphe | Entités liées, connexions indirectes, raisonnement multi-sauts |

Temporel | « Le printemps dernier », « en juin », plages de dates |

Les résultats individuels de ces quatre recherches sont fusionnés via Reciprocal Rank Fusion (RRF), puis réordonnés par un modèle de cross-encoder neuronal. La sortie finale est ajustée pour respecter le budget de tokens du LLM en aval. Le système décide automatiquement comment pondérer chaque stratégie en fonction de la requête, sans que l'appelant ait besoin de spécifier laquelle utiliser.

Cette approche multi-stratégies explique pourquoi Hindsight surpasse les systèmes à stratégie unique. Un RAG classique retrouve des fragments sur « Alice » ou sur « les problèmes d'infrastructure » séparément. Hindsight traverse le graphe : Alice, puis Projet Atlas, puis Kubernetes, puis la panne. Il retourne à la fois la structure de l'équipe et l'incident.

Reflect : l'agent qui apprend

L'opération reflect est ce qui distingue véritablement Hindsight des autres systèmes de mémoire. Elle permet à l'agent de raisonner sur ses souvenirs existants pour former de nouvelles connexions, qui sont ensuite persistées sous forme d'opinions et d'observations.

Le système de réflexion est piloté par CARA (Coherent Adaptive Reasoning Agents), qui intègre des paramètres de disposition configurables dans le processus de raisonnement. Vous pouvez configurer le scepticisme, le littéralisme ou l'empathie de l'agent sur une échelle de 1 à 5. Cela garantit la cohérence du raisonnement entre les sessions : sans ce conditionnement, les agents peuvent générer des réponses localement plausibles mais globalement incohérentes.

Lors de la réflexion, l'agent vérifie les sources dans un ordre de priorité : modèles mentaux, puis observations, puis faits bruts.

Les cas d'usage de reflect sont variés et concrets :

Un chef de projet IA qui réfléchit aux risques à atténuer sur un projet

Un agent commercial qui analyse pourquoi certains messages de prospection obtiennent des réponses et d'autres non

Un agent de support qui identifie les questions des clients auxquelles la documentation actuelle ne répond pas

Les opinions formées lors de la réflexion possèdent des scores de confiance qui évoluent dans le temps. Les preuves concordantes augmentent la confiance. Les contradictions la diminuent, avec une pénalité doublée. Un agent qui suit une technologie depuis des mois développe des perspectives nuancées qu'une simple récupération de documents ne pourrait jamais reproduire.

Benchmarks : 91,4 % sur LongMemEval

Le benchmark LongMemEval évalue les systèmes de mémoire sur des conversations pouvant atteindre 1,5 million de tokens sur plusieurs sessions. Il mesure quatre compétences fondamentales : la récupération précise, l'apprentissage à l'inférence, la compréhension à longue portée et la résolution de conflits.

Résultats comparatifs

Méthode | Modèle backbone | Précision globale (%) |

|---|---|---|

Full-context | OSS-20B | 39,0 |

Full-context | GPT-4o | 60,2 |

Zep | GPT-4o | 71,2 |

Supermemory | GPT-4o | 81,6 |

Supermemory | GPT-5 | 84,6 |

Supermemory | Gemini-3 | 85,2 |

Hindsight | OSS-20B | 83,6 |

Hindsight | OSS-120B | 89,0 |

Hindsight | Gemini-3 | 91,4 |

Plusieurs points méritent votre attention dans ces résultats.

Premièrement, Hindsight avec un modèle open source de 20 milliards de paramètres (83,6 %) surpasse GPT-4o en contexte complet (60,2 %) et même Zep avec GPT-4o (71,2 %). C'est une amélioration de +44,6 points par rapport au baseline en contexte complet. Cela démontre que le problème n'est pas la taille du modèle, mais l'architecture de la mémoire.

Deuxièmement, Hindsight est le premier système open source à franchir la barre des 90 % sur LongMemEval. À 91,4 % avec Gemini-3, il dépasse même Supermemory (85,2 %) qui utilise le même backbone.

Sur le benchmark LoCoMo, un autre test de mémoire conversationnelle à long terme, Hindsight atteint 89,61 % contre 75,78 % pour le meilleur système open source précédent. L'article de recherche, co-écrit avec des collaborateurs de Virginia Tech et du Washington Post, détaille l'ensemble de ces évaluations. Les résultats ont été reproduits indépendamment par le Sanghani Center for Artificial Intelligence and Data Analytics de Virginia Tech.

Les gains les plus spectaculaires concernent les requêtes multi-sessions (+211 %), le raisonnement temporel (+316 %) et les mises à jour de connaissances, soit précisément les cas où les systèmes RAG classiques échouent.

Hindsight vs RAG vs Knowledge Graphs

Pour comprendre la place de Hindsight dans l'écosystème, il est utile de comparer les approches.

Le RAG traditionnel et ses limites

Le RAG classique fait une seule chose : la recherche par similarité sémantique. Il découpe les documents en fragments, les transforme en vecteurs et retrouve les k passages les plus proches. Cette approche est sans état : la même requête produit les mêmes fragments, la même réponse. Le RAG ne peut ni représenter les relations entre entités, ni modéliser l'évolution de l'information dans le temps, ni suivre les connexions entre les faits.

Comme le résume Chris Latimer, cofondateur et PDG de Vectorize : « La plupart des infrastructures RAG existantes que les organisations ont mises en place ne performent pas au niveau souhaité. »

Les knowledge graphs classiques

Les graphes de connaissances traditionnels excellent dans la représentation des relations entre entités, mais ils sont généralement statiques. Ils ne gèrent pas bien l'évolution temporelle, ne distinguent pas les faits des croyances et ne permettent pas aux agents de former des opinions qui évoluent avec de nouvelles preuves.

L'approche hybride de Hindsight

Hindsight combine le meilleur des deux mondes tout en ajoutant des capacités que ni le RAG ni les knowledge graphs ne possèdent :

Capacité | RAG classique | Knowledge graph | Hindsight |

|---|---|---|---|

Recherche sémantique | Oui | Non | Oui |

Recherche par mots-clés | Non | Non | Oui (BM25) |

Relations entre entités | Non | Oui | Oui |

Raisonnement temporel | Non | Limité | Oui |

Opinions avec confiance | Non | Non | Oui |

Apprentissage par réflexion | Non | Non | Oui |

Résolution d'entités | Non | Partiel | Oui |

Séparation faits/croyances | Non | Non | Oui |

Installation et cas d'usage concrets

Démarrage rapide

L'installation de Hindsight est directe. La méthode recommandée utilise Docker :

export OPENAI_API_KEY=your-key

docker run --rm -it --pull always -p 8888:8888 -p 9999:9999 \

-e HINDSIGHT_API_LLM_API_KEY=$OPENAI_API_KEY \

-e HINDSIGHT_API_LLM_MODEL=o3-mini \

-v $HOME/.hindsight-docker:/home/hindsight/.pg0 \

ghcr.io/vectorize-io/hindsight:latestLe système supporte plusieurs fournisseurs de LLM : OpenAI, Anthropic, Gemini, Groq, Ollama et LM Studio. Des clients sont disponibles en Python, TypeScript et Go, plus une CLI et une API REST. Hindsight est agnostique en termes de framework : il fonctionne avec CrewAI, Pydantic AI, Vercel AI SDK, LiteLLM et tout système compatible MCP.

Le code Python pour interagir avec le système est remarquablement concis :

from hindsight_client import Hindsight

client = Hindsight(base_url="http://localhost:8888")

# Stocker une information

client.retain(bank_id="my-bank", content="Alice travaille chez Google")

# Retrouver des souvenirs

client.recall(bank_id="my-bank", query="Que fait Alice ?")

# Réfléchir et générer de nouvelles observations

client.reflect(bank_id="my-bank", query="Que devrais-je savoir sur Alice ?")Cas d'usage en entreprise

Hindsight cible les organisations qui ont déjà déployé une infrastructure RAG mais qui n'obtiennent pas les performances attendues. Le système se positionne comme un remplacement direct des appels API existants.

Les scénarios les plus pertinents incluent :

Agents de support client qui se souviennent des interactions passées, identifient les problèmes récurrents et adaptent leurs réponses en fonction de l'historique complet du client

Assistants de codage qui retiennent les préférences techniques de chaque développeur et apprennent de leurs retours

Agents commerciaux qui suivent les relations avec les prospects sur des mois, mémorisent les objections soulevées et affinent leur approche

Gestionnaires de projet IA qui accumulent des connaissances sur les risques, les dépendances et les décisions prises au fil du temps

Vectorize travaille par ailleurs avec des fournisseurs cloud pour intégrer cette technologie dans les plateformes cloud et renforcer les LLM avec des capacités de mémoire agentique.

Ce que Hindsight change pour l'avenir des agents IA

Hindsight marque un tournant dans la manière dont la communauté technique pense la mémoire des agents. Le projet démontre qu'un système de mémoire bien conçu peut transformer les performances d'un modèle modeste : un modèle open source de 20 milliards de paramètres avec Hindsight surpasse GPT-4o en contexte complet. Le goulot d'étranglement n'a jamais été la taille du modèle, mais la qualité de la mémoire.

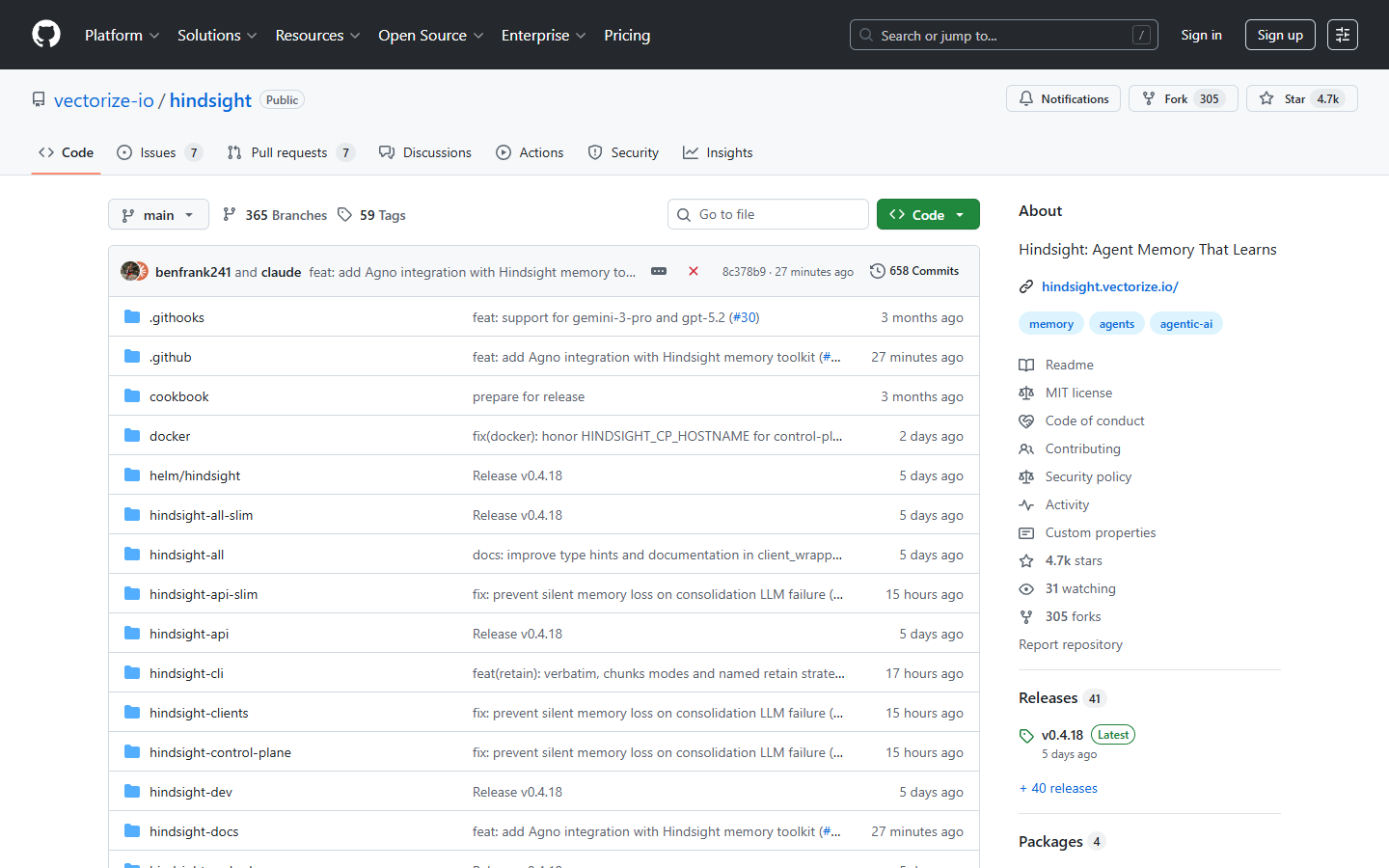

Avec une licence MIT, 4 600 étoiles sur GitHub en croissance rapide, un article de recherche validé par Virginia Tech et le Washington Post, et une architecture qui sépare explicitement les preuves des inférences, Hindsight pose les bases d'une nouvelle génération d'agents capables non seulement de se souvenir, mais véritablement d'apprendre.

Le projet est encore jeune (version 0.2.1 en janvier 2026), mais l'approche biomimétique qu'il propose, en organisant la mémoire en faits, expériences, opinions et observations, offre un cadre qui pourrait bien devenir le standard de l'industrie. Pour les équipes qui construisent des agents destinés à fonctionner sur des semaines ou des mois, avec des utilisateurs récurrents et des contextes évolutifs, Hindsight représente probablement l'avancée la plus significative depuis l'introduction du RAG.

Des prix clairs, transparents et sans frais cachés.

Aucun engagement, des prix pour vous aider à augmenter votre prospection.

Crédits(optionnel)

Vous n'avez pas besoin de crédits si vous voulez simplement envoyer des emails ou faire des actions sur LinkedIn

Peuvent être utilisés pour :

Trouver Emails

Action IA

Trouver des Numéros

Vérifier des Emails

19€par mois

1 000

5 000

10 000

50 000

100 000

1 000 Emails trouvés

1 000 IA Actions

20 Numéros

4 000 Vérifications

19€par mois

Découvrez d'autres articles qui pourraient vous intéresser !

Voir tous les articlesLogiciels

Publié le 24 juin 2025

Expandi vs Waalaxy : Analyse COMPLETE

Niels Co-founder

Niels Co-founderLire la suite

Prospection B2B

Publié le 1 avr. 2025

5 grands fournisseurs de données B2B

Niels Co-founder

Niels Co-founderLire la suite

Prospection B2B

Publié le 19 mai 2025

Maîtriser les e-mails en BCC:pratiques pour une communication efficace

Mathieu Co-founder

Mathieu Co-founderLire la suite

Logiciels

Publié le 24 juin 2025

LeadFuze vs Waalaxy: Analyse complète pour faire le meilleur choix

Niels Co-founder

Niels Co-founderLire la suite

Conseils et formations

Publié le 19 mai 2025

Maîtrisez CFBR LinkedIn : améliorez votre stratégie d'engagement

Niels Co-founder

Niels Co-founderLire la suite

IA

Publié le 18 juin 2025

Les 5 meilleurs générateurs de contenu IA

Niels Co-founder

Niels Co-founderLire la suite

Liens utiles

HubCold-email: Guide CompletDélivrabilité: Guide completAlternative à LemlistAPIDemander une démoProgramme d'affiliationFind emailConsultingA propos

Politique de confidentialitéCGVMentions légalesTestimonialsRoadmapAlternativesComparaisonsContactMade with ❤ for Growth Marketers by Growth Marketers

Copyright © 2026 Emelia All Rights Reserved