Le Hub Emelia

Le meilleur contenu pour faire croître votre business

Articles, conseils, formations, tout ce que vous avez besoin de savoir pour votre prospection B2B.

FEATURED POSTS

Cold email : le guide complet pour se lancer en 2026

Niels Co-founder

Niels Co-founderPublished on 9 juin 2023

Marketing

Comment Scraper LinkedIn Sales Navigator (2026)

Niels Co-founder

Niels Co-founderPublished on 1 févr. 2024

Logiciels

Cold email exemple : guide complet pour écrire un email qui convertit (2026)

Niels Co-founder

Niels Co-founderPublished on 24 avr. 2023

Marketing

Installer l'extension Emelia manuellement

Niels Co-founder

Niels Co-founderPublished on 22 mai 2025

Logiciels

Combien de personnes contacter par jour?

Niels Co-founder

Niels Co-founderPublished on 4 déc. 2022

Conseils et formations

5 options à connaitre chez Emelia

Niels Co-founder

Niels Co-founderPublished on 22 nov. 2021

Tutoriels Emelia

Comment tracker avec son domaine personnalisé?

Niels Co-founder

Niels Co-founderPublished on 24 nov. 2021

Conseils et formations

Email warmup : guide complet 2026 pour chauffer votre adresse email

Niels Co-founder

Niels Co-founderPublished on 2 févr. 2024

Prospection B2B

SPF, DKIM, DMARC : le guide complet pour configurer votre email (2026)

Niels Co-founder

Niels Co-founderPublished on 28 avr. 2026

Prospection B2B

OpenScreen : l'Enregistreur d'Écran Open Source Gratuit Qui Remplace Screen Studio

Niels Co-founder

Niels Co-founderPublished on 1 avr. 2026

IA

Impeccable : la Skill Claude Code Qui Élimine le 'AI Slop' de Vos Interfaces (Guide Complet)

Niels Co-founder

Niels Co-founderPublished on 1 avr. 2026

IA

PentAGI : L'Agent IA Autonome Qui Hacke Pour Vous (Guide Complet et Avis 2026)

Niels Co-founder

Niels Co-founderPublished on 23 mars 2026

IA

Everything Claude Code : Le Repo GitHub à 100 000 Étoiles Qui Transforme Votre Agent IA en Équipe Complète

Niels Co-founder

Niels Co-founderPublished on 23 mars 2026

IA

Claude HUD : Guide Complet du Plugin Qui Change Tout Pour les Utilisateurs de Claude Code

Niels Co-founder

Niels Co-founderPublished on 20 mars 2026

IA

MiroFish : Le Moteur IA de Prédiction par Essaim qui a Reçu 4M€ en 24h (Guide Complet)

Niels Co-founder

Niels Co-founderPublished on 18 mars 2026

IA

Leanstral par Mistral AI : l'IA qui prouve que votre code est correct

Niels Co-founder

Niels Co-founderPublished on 17 mars 2026

IA

Gamma Imagine : Créer des Infographies et Logos Professionnels en 30 Secondes avec l'IA

Niels Co-founder

Niels Co-founderPublished on 16 mars 2026

IA

Firecrawl : l'API qui transforme le web en machine à prospects

Niels Co-founder

Niels Co-founderPublished on 14 mars 2026

IA

AI Voice Agents : les bots qui appellent vos prospects sont-ils vraiment efficaces ?

Niels Co-founder

Niels Co-founderPublished on 12 mars 2026

IA

Claude Code Review : 25$ par code review, est-ce que ca vaut le coup ?

Niels Co-founder

Niels Co-founderPublished on 11 mars 2026

IA

Alibaba AI Coding Plan : coder avec l'IA pour 3$/mois, ca vaut le coup ?

Niels Co-founder

Niels Co-founderPublished on 11 mars 2026

IA

DeepSeek V4 : Guide Complet du Modele IA 1T

Niels Co-founder

Niels Co-founderPublished on 10 mars 2026

IA

6 fournisseurs de proxys résidentiels qui tiennent vraiment leurs promesses

Niels Co-founder

Niels Co-founderPublished on 27 oct. 2025

Blog

Les 5 meilleurs proxys 4G qui ne vous feront pas bannir en 2026

Niels Co-founder

Niels Co-founderPublished on 24 oct. 2025

Blog

Boîte mail française gratuite : top 8 + alternatives (2026)

Mathieu Co-founder

Mathieu Co-founderPublished on 3 sept. 2025

Prospection B2B

LinkedIn et au-delà : découvrez 6 alternatives à Dripify

Mathieu Co-founder

Mathieu Co-founderPublished on 2 sept. 2025

LinkedIn

Vous cherchez mieux que Klenty ? On a testé 7 alternatives puissantes

Mathieu Co-founder

Mathieu Co-founderPublished on 1 sept. 2025

Prospection B2B

On a comparé Salesloft et 7 alternatives : notre guide complet pour la prospection B2B

Mathieu Co-founder

Mathieu Co-founderPublished on 1 sept. 2025

Prospection B2B

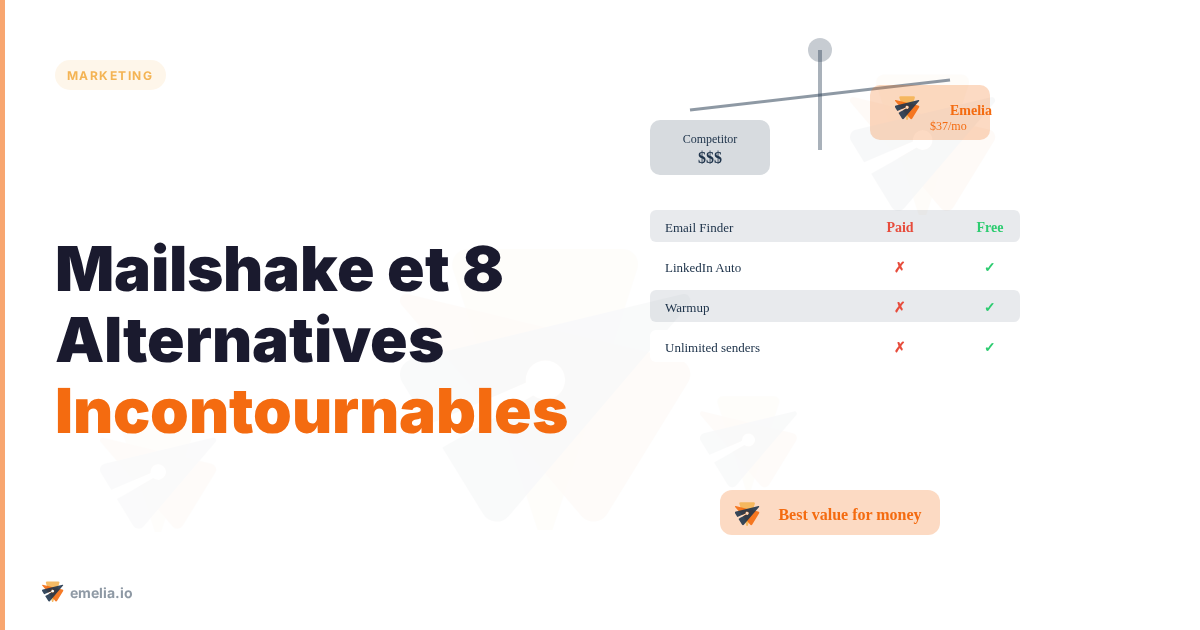

Mailshake et 8 Alternatives Incontournables pour Révolutionner Votre Prospection

Niels Co-founder

Niels Co-founderPublished on 1 sept. 2025

Prospection B2B

Tout ce que vous devez savoir sur les 8 alternatives à Instantly

Mathieu Co-founder

Mathieu Co-founderPublished on 29 août 2025

Prospection B2B

QuickMail face à la concurrence : 7 alternatives pour des campagnes plus performantes

Niels Co-founder

Niels Co-founderPublished on 27 août 2025

Prospection B2B

Smartlead, c’est utile mais voici 8 alternatives qui changent la donne

Mathieu Co-founder

Mathieu Co-founderPublished on 27 août 2025

Prospection B2B

Liens utiles

HubCold-email: Guide CompletDélivrabilité: Guide completAlternative à LemlistAPIDemander une démoProgramme d'affiliationFind emailConsultingA propos

Politique de confidentialitéCGVMentions légalesTestimonialsRoadmapAlternativesComparaisonsContactMade with ❤ for Growth Marketers by Growth Marketers

Copyright © 2026 Emelia All Rights Reserved